针对眼部掩模的人脸识别对抗贴片研究

关键词:贴片攻击者人脸识别

崔廷玉,张 武,贺正芸,2,周星宇,张 瑶,胡谷雨,潘志松

(1.陆军工程大学 指挥控制工程学院,江苏 南京 210007;2.湖南工业大学 轨道交通学院,湖南 株洲 412008;3.陆军工程大学 通信工程学院,江苏 南京 210007)

0 引 言

近年来,随着深度学习技术的快速发展,人脸识别被广泛应用于现实世界的工作与生活中,其中包括门禁系统、监管系统等。然而,深度神经网络在对抗样本面前会表现出极大的脆弱性。Szegedy等人[1]发现,通过在图像上添加微小扰动可以使得深度神经网络模型错误分类。Moosavi-Dezfooli等人[2]证明了“扰动普遍存在”。随后,GoodFellow等人[3]提出了对抗样本的概念。

现有的人脸识别方法大多基于深度神经网络,因此,通过对人脸图像添加攻击性扰动同样会对人脸识别模型造成影响。例如,Song等人[4]提出一种注意力机制的对抗攻击生成网络生成对抗样本。Dong等人[5]提出一种基于决策的演化攻击算法。Deb等人[6]通过生成对抗网络自动生成对抗性人脸。Zhu等人[7]通过修改语义信息生成对抗样本。Sharif等人[8]通过一种通用的方法训练生成神经网络以生成对抗样本。Zhong等人[9]提出了一种基于dropout技术的DFANet攻击算法。

以往的攻击方法大多在数字场景下对图像全局添加扰动,往往在现实世界中难以实现。为验证对抗攻击在现实场景中的实用性,Kurakin等人[10]用手机拍摄打印出来的对抗样本欺骗分类网络。Shen等人[11]利用投影设备将对抗扰动投影到脸部实现对人脸识别模型的对抗攻击。

为提高对抗样本在物理世界中的实用性,基于对抗贴片的攻击方法被提出。Brown等人[12]提出了局部可视化扰动方法,将对抗贴片通过打印实现物理场景的对抗攻击。构造现实世界对抗样本最成功的范例是期望转换(Expectation Over Transformation,EOT)算法[13],通过对图像进行一系列转换增强对抗样本的鲁棒性。而后,Sharif等人[14]提出一种使用基于优化的方法生成针对眼镜区域的对抗贴片。Komkov和Petiushko等人[15]在帽子区域添加扰动以生成对抗贴片(AdvHat)。

AdvHat方法虽然具有良好的白盒攻击性能,但是其黑盒场景下的可迁移性较差,无法在现实世界实现对抗攻击。Feng等人[16]研究表明,眼部区域包含了较多的特征信息,因而在AdvHat方法的基础上,该文提出一种新的针对类似于人眼面具的眼部掩模的对抗贴片生成方法(AdvEyeMask)。该方法引入了动量的思想,并对输入图像应用了添加随机噪声、亮度调整以及随机放缩等多样性变换,并根据图像的平移不变特性对梯度矩阵进行高斯核卷积处理。该文分别在单模型、集成模型场景下对AdvEyeMask方法进行了实验与分析,并在物理场景下进行了攻击某商用人脸识别设备的实验,并取得了成功。

总体而言,主要贡献如下:

(1)提出一种新的针对眼部掩模的对抗贴片生成方法(Adversarial Eye Mask,AdvEyeMask),具有较高的白盒攻击性能,并利用商业人脸比对API成功实现黑盒攻击。随后进行了溯源实验并证明佩戴对抗贴片的攻击者可以避免身份的暴露。

(2)将AdvEyeMask方法与现有的AdvHat方法进行攻击性能对比实验,验证AdvEyeMask方法的有效性。

(3)为证明AdvEyeMask方法生成对抗贴片在现实世界中的鲁棒性,在物理场景下进行了攻击某商用人脸识别设备的实验,并实现成功攻击。

1 相关研究现状概述

1.1 对抗样本描述

对于原始数据x,其真实标签为ytrue,预训练得到的模型分类器为f(・),则对于模型分类器,可以对原始数据进行正确分类,即f(x)=ytrue。当攻击者向原始数据添加扰动产生新的数据,即xadv=x+δ,使得分类器对xadv的分类产生新的结果,即f(xadv)=ytarget,其中ytarget≠ytrue,则称通过对原始数据添加扰动产生的新的数据xadv为对抗样本。其中,若ytarget为指定目标,则称xadv为有目标对抗样本,否则称为无目标对抗样本。该文是针对指定的目标人物进行攻击,故属于有目标对抗。

1.2 基于梯度的攻击方法

基于梯度的对抗攻击方法是一种常见的白盒攻击方法,Goodfellow等人最早提出了FGSM方法,该方法计算输入的损失函数的梯度,并通过选定的常数与梯度符号向量相乘来产生小的扰动。而后,Kurakin等人[17]对FGSM方法引入迭代的思想提出了BIM方法,以迭代的方式沿着梯度增加的方向进行多步小的扰动。相比FGSM方法而言,BIM方法获取的扰动更加准确。Dong等人[18]提出一种基于动量迭代的FGSM(Momentum Iterative FGSM,MI-FGSM)方法。该方法将动量项整合到攻击过程中,有助于逃离局部极大值,提高对抗样本的可迁移性。针对图像在现实场景中的变换以及图像平移不变性,分别提出了DIM方法[19]与TIM方法。这两种方法缓解了过拟合现象,在黑盒场景设置下实现较好的攻击效果。

2 针对眼部掩模的人脸识别对抗贴片生成算法

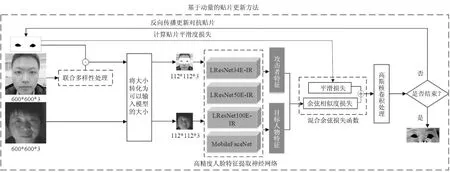

该文提出一种新的基于眼部掩模的对抗贴片的生成方法(Adversarial Eye Mask,AdvEyeMask)。基于动量的贴片更新方法如图1所示。算法主要包含联合多样性处理、高精度人脸特征提取特征网络以及混合余弦损失函数三部分。首先,该方法对攻击者图像添加随机噪声、亮度调整以及随机放缩填充等多样性变换,增强对抗贴片的环境适应性。将眼部掩模与攻击者人脸图像相结合,对所得人脸图像进行大小转换处理并输入到人脸识别网络模型中,利用多个现有的人脸识别模型分别对输入人脸图像进行特征提取,并对各模型获得的特征进行结合,以获得输入人脸的特征,将面具人脸与目标人脸的余弦相似度损失与平滑度损失相结合构成混合余弦损失函数,最后对目标损失函数反向求导并更新对抗贴片。

图1 算法流程

2.1 基于动量的贴片更新方法

该文提出一种新的针对眼部掩模的对抗样本生成方法,该方法采用基于梯度的攻击方法,对目标损失函数进行反向求导以获得输入图像的梯度信息,进而对迭代过程中的对抗贴片进行更新。在计算图像梯度信息的过程中,引入了多样性攻击方法DIM,对输入图像进行多样性变换,来缓解迭代过程中的过拟合现象。此外,还引入了动量的思想,通过MI-FGSM方法避免陷入局部极大值,稳定更新方向。并且针对图像的平移不变特性,引入了TIM方法[20],利用预定义的高斯核对图像的梯度矩阵进行卷积操作,从而降低生成的对抗贴片对白盒模型的敏感程度。对抗贴片更新过程表示如下:

xdiv=D(B(x+noise))

(1)

(2)

gt+1=μ・gt+(1-μ)・{W*

(3)

Pt+1=Clip[0,1]{Pt-α・sign(gt+1)}

(4)

此外,实验中借鉴了Komkov等人提出的两阶段梯度更新方式,分别在第一阶段和第二阶段进行梯度更新时设置了不同的步长和动量平衡因子。在第一阶段快速得到眼部区域对抗贴片的同时,通过第二阶段进一步对贴片进行优化。每阶段中,根据最近100次相似度值形成的线性回归模型系数是否大于等于0,以此作为该阶段结束的条件。

2.2 联合多样性处理与高斯核卷积处理

为提高生成的对抗样本在黑盒场景下的攻击性能,该文在训练过程中对输入图像进行联合多样性处理,并针对图像平移不变特性,对目标损失进行高斯核卷积处理,提高了对抗样本的黑盒攻击性能。

2.2.1 联合多样性处理

为了提高对抗样本在物理场景下应用的鲁棒性,采用联合多样性处理的思想,对输入图像进行添加随机噪声、随机亮度调整以及缩放填充以实现对现实场景下发生的变化进行模拟。

2.2.2 高斯核卷积处理

针对图像的平移不变特性,对迭代中目标损失的梯度信息进行高斯核卷积处理。该方法的使用增强了生成的对抗样本的迁移性,降低了生成的对抗样本对白盒模型的敏感程度,提高了对抗样本的黑盒攻击性能。

(5)

其中,W为预定义的高斯核,模糊矩阵的梯度。

2.3 高精度人脸特征提取神经网络

该文使用了4个预训练模型分别对输入图像进行特征提取,所选用的人脸识别模型分别为LResNet34E-IR、LResNet50E-IR、LResNet100E-IR以及MobileFaceNet。LResNetE-IR与MobileFaceNet网络结构可对人脸进行高精度特征提取,高效地实现人脸识别任务。

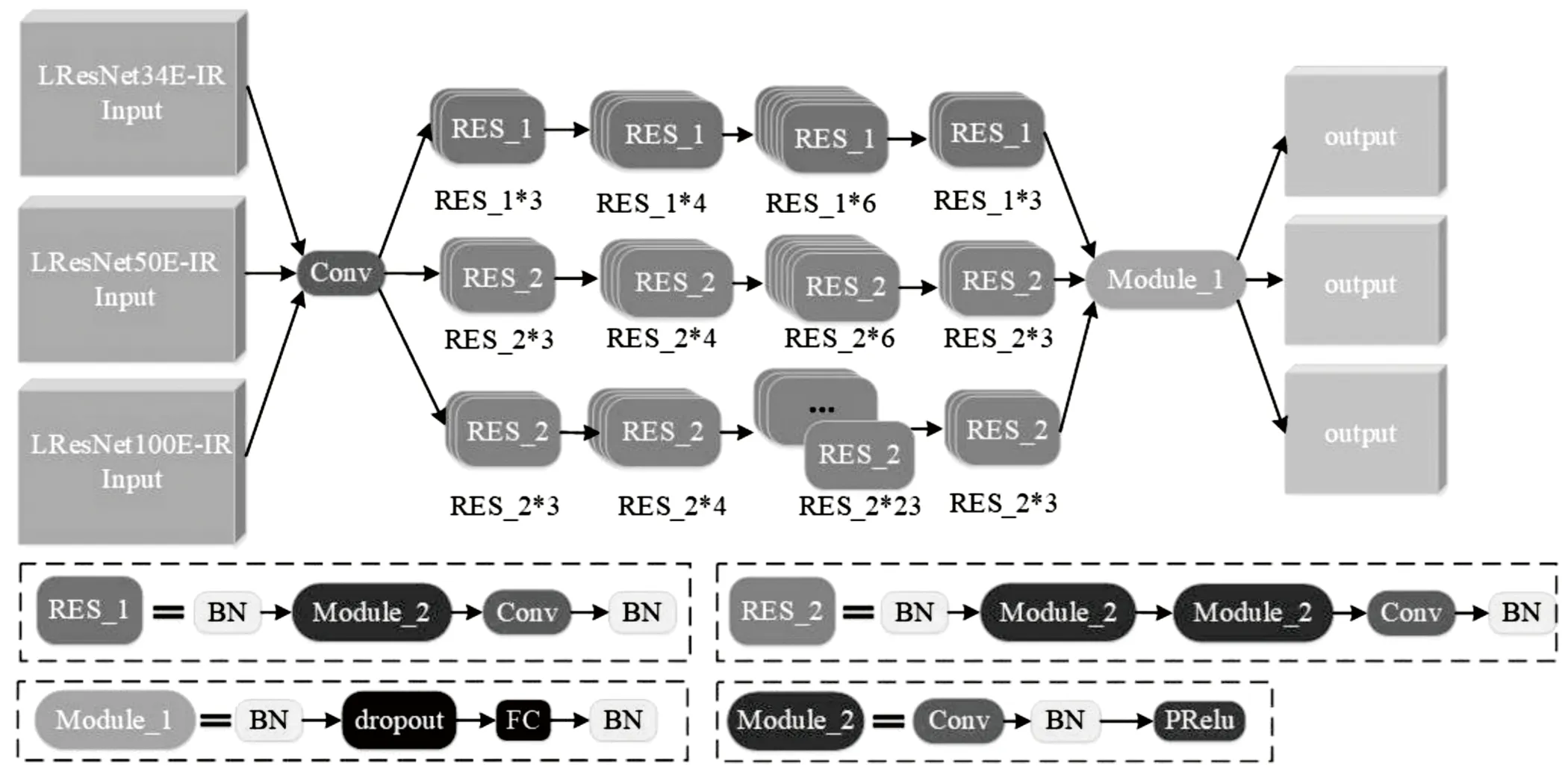

2.3.1 LResNetE-IR网络

为得到更适合人脸识别的预训练模型,对ResNet网络的设置进行了改动[21]。图2为LResNetE-IR的网络结构。首先,对于网络的输入,将预训练模型的第一个大小为7×7,步长为2的卷积层替换为大小为3×3,步长为1的卷积层,因此在训练过程中保持了高维特征映射的分辨率。原主干网络ResNet所采用输入大小也由224×224转换为112×112。此外,采用BN-Conv-BN-PReLu-Conv-BN结构作为残差块,并在残差块中将第一个卷积层的步长从2调整到1,激活函数采用PReLu替代了原来的ReLu,使得改善后的网络结构更适合于人脸识别模型的训练,而后在最后的卷积层之后添加BN-Dropout-FC-BN模块。

图2 LResNetE-IR网络结构

2.3.2 MobileFaceNets网络

MobileFaceNets是在MobileNetV2的基础上所得的卷积网络。MobileNetV2网络通过平均池化模块对人脸特征进行提取。针对平均池化方法识别精度下降的弊端,Chen等人[22]提出以全局加权池化替代平均池化方法,避免了均值化效果以及提高预训练模型工作性能,进而得到MobileFaceNets网络。

2.4 混合余弦损失函数

该文将余弦相似度损失与TV损失函数相结合作为目标损失函数,对每次迭代中得到的损失进行反向求导以更新对抗贴片。使用余弦相似度损失函数求解攻击者与目标人物的相似度损失,以及通过TV损失函数平滑处理对抗贴片,使得生成的对抗贴片更加真实自然。

2.4.1 余弦相似度损失

余弦相似度可以衡量个体之间的差异性。当两个向量间的夹角趋于0时,余弦值越接近于1,表明两个向量相似度越高;当两个向量夹角趋于90度时,余弦值越接近于0,表明两个向量相似度越低。余弦相似度如公式(6)所示:

(6)

余弦相似度实现方法如公式(7)所示:

Lcosine(xadj,xtar)=-cos(exadj,extar)

(7)

其中,cos()为余弦距离函数,exadj和extar分别表示佩戴面具的人脸与目标人脸的特征向量。余弦相似度损失越小,面具人脸与目标人脸相似度越大。

2.4.2 平滑损失

平滑损失(TV loss)作为一种常用的正则项,通过降低TV loss可以在一定程度上起到减小图像中相邻像素差异的作用。该文引入了平滑度损失进行衡量,TV值越小平滑度损失越小,生成对抗贴片更具平滑自然性。平滑损失函数如公式(8)所示:

(8)

其中,Pi,j表示生成的对抗贴片中的像素点坐标(i,j)对应的像素值。

该文将平滑损失与余弦相似度损失相结合构造目标损失函数,并通过所得目标损失迭代更新对抗贴片:

L(xadj,ytar)=Lcosine(xadj,xtar)+ε・Ltv(P)

(9)

该文沿用AdvHat方法中对平滑损失权重的设定,将平滑损失权重ε设置为0.000 1。

以下为对抗贴片生成算法。

对抗贴片生成算法:

输入:攻击者人脸图像x,佩戴对抗贴片的攻击者人脸图像xadj,目标者人脸图像xtar,对抗贴片位置掩膜M,步长α,动量平衡因子μ,平滑损失权重ε,高斯卷积核W;

输出:对抗贴片P;

初始化参数:初始贴片P0为白色,回归模型初始系数coef=-1,t=0,stage=1

while stage≤ 2 do

输入多样性变换,如公式(1)(2)所示。

目标损失,如公式(9)所示。

目标损失反向求导并利用高斯核对其进行卷积进而求得梯度,如公式(3)所示。

贴片更新,如公式(4)所示。

观察近100次迭代相似度的值形成的线性回归模型更新系数coef

end while

输出对抗贴片:returnP=Pt+1

对当前迭代次数进行判断:

3 实验结果与分析

本节分别对单模型以及集成模型的攻击实验进行详细说明,其中包括实验所需的数据集选取、参数以及模型设置等。此外,进行了消融实验,增加了实验可对比性。为体现AdvEyeMask方法的有效性与实用性,还对所得对抗样本进行了溯源实验来进行说明。而后,令佩戴对抗贴片的攻击者攻击某商用人脸识别设备,验证其物理场景对抗攻击性能。

3.1 实验设置

3.1.1 数据集与参数设置

实验中选取CASIA-FaceV5亚洲人脸数据库中的500名人员人脸图像作为目标对象,构成500张目标人脸数据集,其中男性图像与女性图像数量比例接近1∶1。此外,还选取了实验室中一男一女两名人员人脸图像作为攻击人脸,构成包含两张人脸图像攻击者数据集。

此外,实验中借鉴了Komkov等人提出的两阶段梯度更新方式,分别在第一阶段设置步长为1/51,以及设置动量平衡因子为0.9;在第二阶段设置步长为1/255,设置动量平衡因子为0.995。

3.1.2 模型设置

实验选取了InsightFace Model Zoo中四个经过训练的人脸识别模型作为攻击对象,分别为LResNet34E-IR、LResNet50E-IR、LResNet100E-IR以及MobileFaceNet。这四个网络模型的网络体系结构有所不同,其中LResNet34E-IR、LResNet50E-IR以及LResNet100E-IR以ResNet网络作为主体架构,模型MobileFaceNet的主体架构则是MobileNet网络。实验表明,模型LResNet34E-IR、LResNet50E -IR、LResNet100E-IR以及MobileFaceNet在LFW数据集上的识别精度分别达到了80.08%、99.80%、99.77%和99.50%。

3.1.3 评价指标

当前,人脸识别系统工作原理大多为:对输入人脸与数据库人脸进行特征相似度比对,若特征相似度超过系统设定阈值,则判定为匹配成功。同时,各个人脸识别系统所设置的阈值大小可能会略有不同。该文选取某厂商人脸识别设备的相似度阈值0.70作为识别阈值,即当特征相似度超过0.70时,则判定为攻击成功,反之,则为攻击失败。

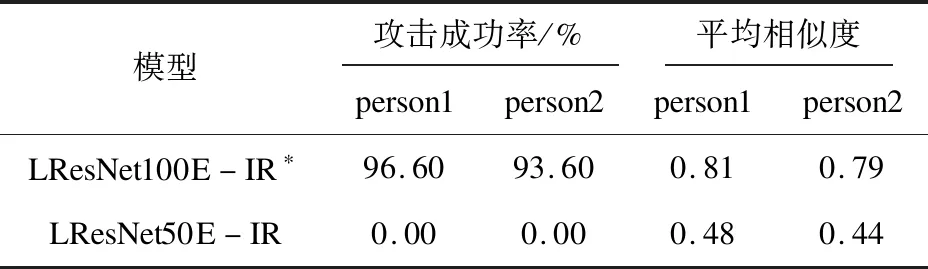

3.2 单模型攻击实验

本节将介绍利用单模型LResNet- 100E-IR进行攻击实验,使每位攻击者分别针对500张目标人脸图像进行攻击,生成相应的对抗贴片,并测试白盒攻击成功率。实验结果如表1所示,原始图像均不能导致LResNet100E-IR产生错误分类;而面具人脸分别以99.60%和93.60%的攻击成功率使得白盒模型产生误判。此外,表中可以看出在白盒场景下,两位佩戴对抗贴片的攻击者与目标人脸分别实现0.81和0.79的平均相似度,AdvEyeMask方法显著提升了平均相似度,可以在白盒设置下实现良好的攻击效果。

表1 单模型生成对抗贴片的攻击成功率与平均相似度

3.3 集成模型攻击实验

单模型攻击所生成的对抗样本虽有良好的白盒攻击性能,但现实场景中模型多为黑盒模型,故单模型攻击不适用于现实场景。如表1所示,佩戴基于单模型LResNet100E-IR生成的对抗贴片的攻击者person1和person2,攻击黑盒模型LResNet50E-IR时仅分别达到0.48和0.44的平均相似度,在识别阈值设定为0.70的条件下无法成功实现黑盒攻击。对此,实验中将模型LResNet34E-IR、LResNet50E-IR、LResNet100E-IR以及MobileFace- Net进行集成,针对所生成的对抗贴片,利用百度API对佩戴对抗贴片的攻击者与目标人脸进行比对,求得黑盒场景下的人脸特征相似度。分别对佩戴单模型与集成模型生成对抗贴片攻击者人脸通过百度API进行相似度比对,如表2所示,两位佩戴单模型对抗贴片攻击者对百度API的攻击成功率分别为33.20%和17.80%,而佩戴集成模型对抗贴片的攻击成功率达到了69.60%和64.20%。由此可见,集成方法攻击成功率得到了较大提升。

表2 分别佩戴在单模型与集成模型生成对抗贴片的攻击者对目标人物的攻击成功率与平均相似度(百度API)

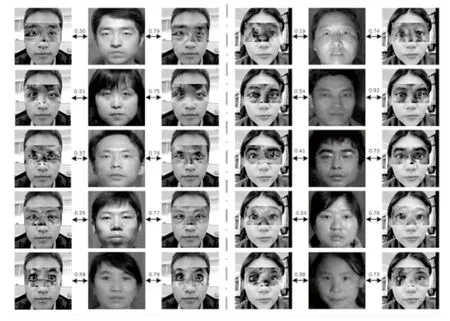

图3中为单模型与集成模型方法攻击性能对比示例,其中在每组攻击者示例中,左列图像为单模型方法,右列为集成模型方法,中间为目标人脸。由图中可以清晰地看出,集成模型方法具有更好的黑盒攻击性能。

图3 单模型与集成模型方法生成对抗贴片攻击效果对比

此外,表中还对佩戴单模型与集成模型方法与目标人脸的平均相似度进行统计。可以看出,通过集成模型方法可以使得攻击者和目标人物的平均相似度提升超过0.10。因此,可以证明集成模型方法对于攻击性能提升的有效性。

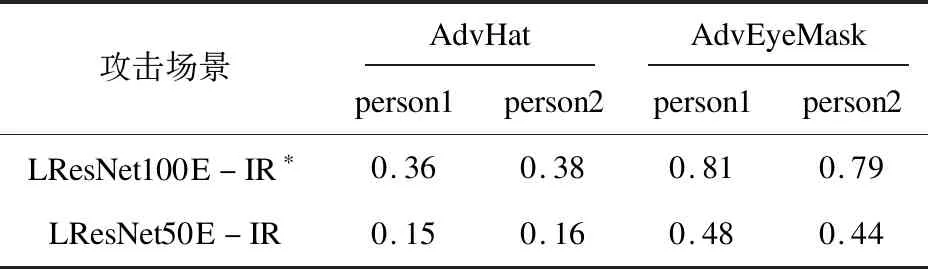

3.4 消融实验

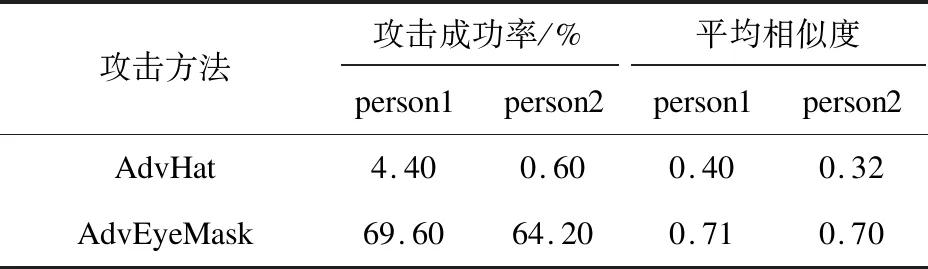

本节将AdvEyeMask方法与AdvHat方法的攻击性能进行了对比。分别在LResNet100E-IR单模型与集成模型的实验场景下,通过两种方法生成对抗贴片,并对其特征相似度进行了比较。表3分别为AdvHat方法与AdvEyeMask方法在单模型场景下与目标人物在白盒模型LResNet100E-IR与LResNet50E-IR黑盒模型攻击场景下的平均相似度,可以看出,相比于AdvHat方法,AdvEyeMask方法可以使得攻击者与目标人物的平均相似度在白盒场景下实现0.41的提升,并且在黑盒场景下达到0.28的提升。表4展示了Adv-Hat方法与AdvEyeMask方法利用集成模型生成对抗贴片,在百度API平台所得攻击成功率与平均相似度。由表4可知,AdvEyeMask方法可以使得平均相似度比AdvHat方法提升0.31和0.38。由AdvEyeMask方法与AdvHat方法相比在百度API测试攻击成功率提升64.4百分点。由实验可得AdvEyeMask方法可以获得比AdvHat方法更强的攻击性能。

表3 佩戴由AdvHat方法与AdvEyeMask方法在单模型场景下生成的对抗贴片的攻击者与目标人物分别在白盒攻击与黑盒攻击场景下的平均相似度

表4 佩戴AdvHat方法与AdvEyeMask方法在集成模型上生成的对抗贴片的攻击者与目标人物的攻击成功率与平均相似度(百度API)

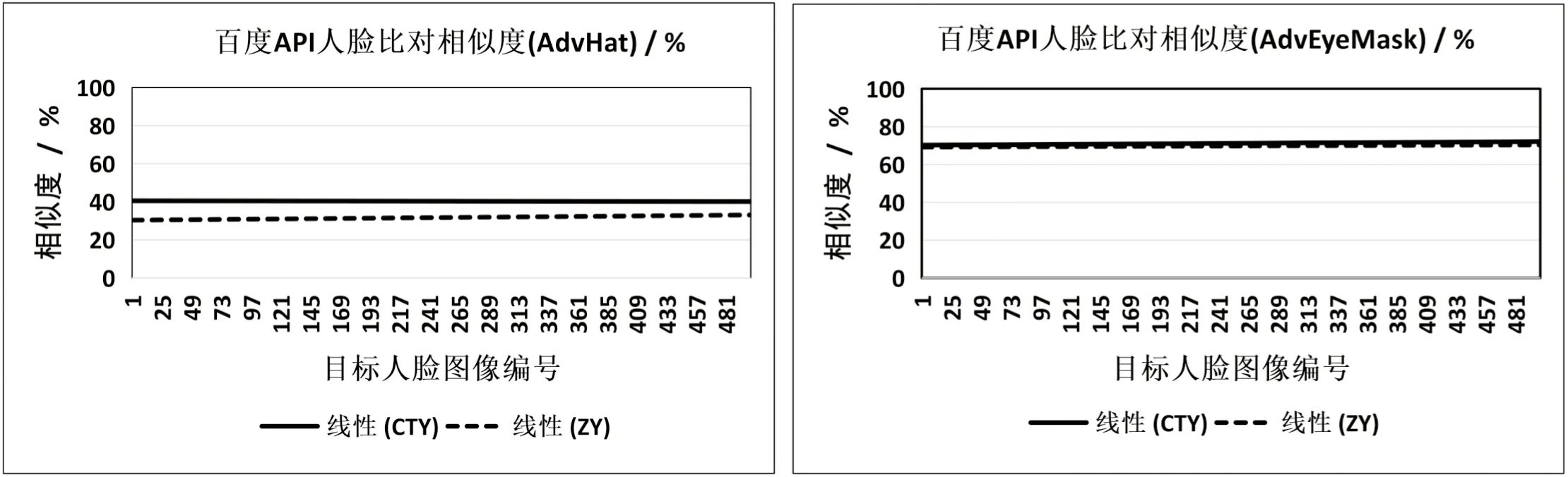

此外,将集成模型场景下两种攻击方法人脸比对相似度以折线图形式进行展示。如图4所示,左图为AdvHat方法在百度API所得相似度趋势统计图,右图为AdvEyeMask方法通过百度API平台测试所得相似度趋势统计图。图中实线部分为攻击者1的相似度趋势曲线,虚线部分为攻击者2相似度的趋势曲线。由图中可以看出,AdvEyeMask方法人脸比对相似度趋势为0.70左右,而通过AdvHat方法人脸比对相似度趋势仅为0.30与0.40左右,因而,AdvEyeMask方法在相似度上明显高于AdvHat方法。

图4 人脸比对相似度折线图

3.5 溯源实验

在实际应用中还应考虑攻击者的真实身份是否会暴露。对此,实验中分别测试了两位攻击者在佩戴贴片前后的相似度,相似度越低,攻击者暴露的可能性越小。期间对集成模型方法通过四种现有的人脸识别模型进行实验,对佩戴贴片前后的攻击者平均相似度进行比较,进而对溯源性进行说明。实验结果如表5所示,由此可以看出佩戴贴片前后的攻击者具有较低的平均相似度,在四种现有的人脸识别模型攻击成功率均为0,无法成功实现对抗攻击,因而在现实场景应用中不会轻易暴露攻击者身份。

表5 集成模型生成对抗贴片在溯源实验中所得的平均相似度

3.6 物理场景攻击实验

为进一步测试对抗贴片的物理场景攻击效果,该文设计并实验了AdvEyeMask方法在物理场景下的攻击性能。实验选取某款商用人脸识别设备作为攻击对象,选取一名实验人员作为攻击者,对其他四名目标人脸进行对抗攻击。而后,将AdvEyeMask方法通过打印获得真实贴片。实验中,佩戴对抗贴片的攻击者在人脸识别设备前分别进行近、远、上、下、左、右的变换,以此来观察对抗贴片的鲁棒性。

如图5所示,给出了物理场景下佩戴对抗贴片的攻击者攻击人脸识别设备的实验效果。在六种不同的视角情况下,佩戴对抗贴片的攻击者均可以实现成功攻击,结果表明,AdvEyeMask方法在物理场景下可实现对某商用人脸识别设备的有效攻击。

4 结束语

该文设计了一种新的针对人的眼部掩模的对抗贴片生成方法(AdvEyeMask),生成的对抗贴片具有良好的鲁棒性,而且在白盒和黑盒场景下都可实现较好攻击,并且在攻击现有的人脸识别系统时可以实现较高的攻击成功率。进行了单模型以及集成模型攻击实验,实验结果表明,AdvEyeMask方法生成的对抗贴片可以实现较高的白盒攻击成功率,并在一定程度上对百度API实现黑盒攻击。将AdvEyeMask方法与AdvHat方法进行对比,实验证明AdvEyeMask方法在白盒以及黑盒场景下攻击性能均得到了较大的提高。此外,文中对AdvEyeMask方法溯源性进行分析,实验结果表明佩戴对抗贴片的攻击者身份不易被暴露。最后,实验了物理场景下佩戴对抗贴片的攻击者对某商用人脸识别设备的攻击性能,并实现成功攻击。